Los visitantes del MWC 2024 fueron buscando móviles y acabaron viendo coches eléctricos

Pese al nombre de la feria, el protagonista no ha sido el teléfono móvil, sino el coche eléctrico. El stand con más miradas ha sido el de Xiaomi, quien ha mostrado por primera vez en Europa el SU7.

La GSMA mostraba en su stand el Renault H1st Vision, un coche eléctrico conceptual bastante rompedor. Compañías como MediaTek o Qualcomm reservaban enormes espacios a sus demos para soluciones de hardware y software para vehículos conectados. Un Mobile sin apenas novedades en móviles y repleto de novedades para coches.

El coche de Xiaomi, inevitable protagonista

No todos los días puede verse un coche eléctrico fabricado por la marca n1 en España en telefonía móvil. El Xiaomi SU7 Max se presentó hace unos meses en China, y se ha dejado ver en el stand de la compañía.

Ningún periodista falló: el día uno de la feria todos acudieron con premura al stand de Xiaomi para grabar y fotografiar el coche. No había un solo stand más importante en toda la feria ni producto más interesante.

Ni siquiera sabemos cuándo llegará a Europa. Tampoco conocemos su precio (la marca nos da una horquilla de entre 50 y 70 mil euros), ni se pudo probar de forma alguna. No importó: fue el rey de la fiesta.

El Xiaomi 14 Ultra, los modelos de la familia POCO y los pocos productos de ecosistema estaban en un segundo plano. Muy pocas unidades de producto. La sensación era la de que solo importaba el coche.

Qualcomm y MediaTek, a la carrera por el coche eléctrico

El stand de Qualcomm era bastante dinámico. Unas cuantas demos de cómo la IA generativa de sus procesadores puede generar imágenes, información sobre sus módems, tecnologías WiFi 7 y, al final del stand, un generoso espacio reservado a su cockpit digital.

La compañía nos explicó cómo está trabajando con los grandes fabricantes para implementar chips que controlen la interfaz (recalcan la importancia de la seguridad en estos chips, ya que no pueden fallar en ninguna circunstancia), y cómo Android Automotive jugará un papel central en coches eléctricos.

El objetivo es que Automotive sea el principal sistema operativo en coches eléctricos, y los fabricantes de chips pugnan por ofrecer el mejor hardware para ellos.

Es una lucha en la que también estaba presente MediaTek, con un generoso espacio de "Dimensity Auto" en el que nos mostraban cómo sus procesadores son capaces de conectar el vehículo a la red, y cómo de rápido pueden ejecutar tanto aplicaciones como funciones nativas del UI del coche.

Conceptos e ideas a futuro

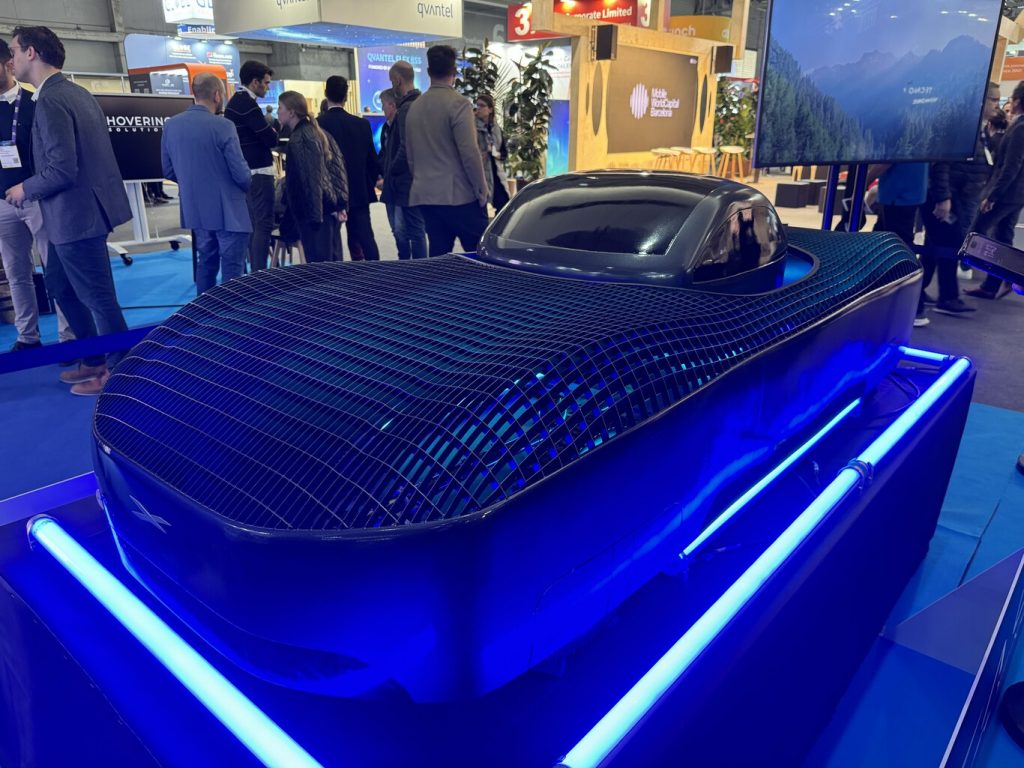

En el Mobile World Congress 2024 también pude ver el Renault H1st Vision, uno de los coches eléctricos más espectaculares de la feria y una propuesta conceptual increíble. Este coche es una colaboración entre Renault y Software République, una gigantesca asociación entre gigantes como Orange, Eviden y Dassault Systemes, entre otros.

Este es un coche que intercambia constantemente datos con el entorno que recorre, usando IA en tiempo real para trazar mapas de la red de carreteras, utilizar los datos de otros vehículos conectados para detectar probabilidad de accidentes, analizar defectos en la carretera, etc.

Incluso es capaz mediante un sistema de sensores de analizar nuestras expresiones faciales y tono de voz. Esto le sirve para detectar nuestro estado de salud, fatiga, e incluso hacernos recomendaciones y sugerencias de ejercicios sobre respiración, descanso al volante y demás.

No todos los coches tienen que tener ruedas

Ni siquiera todos los vehículos eléctricos del MWC 24 estaban fijados al suelo. Cerca del coche de Xiaomi pudimos ver uno de los productos más impresionantes de la feria, el coche volador de Alef. No logró alcanzar el vuelo en el stand, pero es un interesante concepto de un vehículo certificado por la FAA, algo que le permite hacer pruebas aéreas.

Más realista, pero no menos espectacular, era el S4SKT de EK, un taxi aéreo que según la marca empezaremos a ver de forma operativa en Seúl a partir de 2025. Es un vehículo espectacular, ultra silencioso y una declaración de intenciones para el futuro de los coches aéreos.

Coches que llegarán al mercado. Coches que no. Coches que vuelan. Coches. El MWC 2024 sigue alejado de la inmensa batería de novedades que se pueden disfrutar en una feria de motor, pero es significativa la presencia de este tipo de proyectos, así como los espacios reservados por gigantes como Xiaomi, Google, MediaTek o Qualcomm para un solo fin: el coche eléctrico.

Qué son Vertex AI y Google AI Studio, las herramientas de desarrollo de inteligencia artificial que ya permiten usar Gemini Pro

Google facilita con estas herramientas que los desarrolladores creen aplicaciones basadas en Gemini (y otros modelos de IA)

En este último año, hemos experimentado el mayor auge de la historia en aplicaciones y plataformas basadas en IA orientadas al usuario final. Pero también han surgido numerosas herramientas destinadas al desarrollo de aplicaciones basadas en IA. Y Google no se ha quedado atrás en este campo, con el lanzamiento de Vertex AI y Google AI Studio.

¿Qué es Vertex AI?

Vertex AI, lanzada por Google Cloud, es una plataforma de desarrollo y operaciones de inteligencia artificial (AIOps) que permite a las organizaciones desarrollar, desplegar y gestionar sus modelos de IA.

La plataforma permite a los desarrolladores y científicos de datos centrarse más en sus proyectos y menos en la infraestructura, pues Vertex AI ya proporciona un entorno gestionado para entrenar, alojar y desplegar modelos de IA, ofreciendo una serie de funcionalidades clave:

- Entrenamiento automatizado de modelos: Vertex AI ofrece AutoML, una característica que automatiza la creación de modelos de ML. Los usuarios pueden entrenar modelos de alta calidad con mínima experiencia en ML.

- Entorno unificado para ML: Permite a los usuarios gestionar todo el ciclo de vida del 'machine learning', desde la preparación de datos hasta las predicciones, en una sola plataforma.

- Integración con otras herramientas de Google Cloud.

Así como de componentes especializados como, por ejemplo…

- Vertex AI Search: Esta herramienta se centra en mejorar las capacidades de búsqueda en aplicaciones y sitios web. Utiliza modelos avanzados de inteligencia artificial para proporcionar resultados de búsqueda más relevantes y personalizados. Puede analizar y entender grandes volúmenes de datos, incluyendo texto, imágenes y otros medios, para ofrecer respuestas y recomendaciones más precisas a las consultas de búsqueda.

- Vertex AI Conversation: Este componente está diseñado para crear y gestionar chatbots e interfaces de conversación. Utiliza modelos de procesamiento de lenguaje natural y aprendizaje automático para entender y responder a las consultas de los usuarios de manera natural y eficiente. Vertex AI Conversation permite a las empresas desarrollar asistentes virtuales que pueden interactuar con los usuarios a través de texto o voz, ofreciendo respuestas y soporte en una variedad de aplicaciones y plataformas.

- Herramientas para científicos de datos: Como Notebooks, TensorFlow, PyTorch, etc.

Google lanzó hace unos días unos cursos gratuitos sobre IA que abordaban también la introducción al uso de esta herramienta.

Google AI Studio

Recientemente, Google ha presentado también su 'Google AI Studio', una nueva plataforma web que brinda a los desarrolladores un acceso sencillo a sus recientemente anunciados modelos de IA Gemini. Este servicio permite a los creadores desarrollar y desplegar rápidamente chatbots, aplicaciones y otro software impulsado por las capacidades de generación de lenguaje natural de Gemini.

Esta herramienta —un rebranding y una mejora de otra herramienta preexistente de Google, MakerSuite— proporciona cuotas de uso gratuitas, bibliotecas de código y herramientas para comenzar a desarrollar con su nuevo modelo de lenguaje estrella.

Las mejoras incluyen controles de ajuste para la seguridad, prompts y estilos de salida, además de flujos de trabajo estructurados adaptados a formatos como el diálogo, preguntas y respuestas, resúmenes y más.

Así lo cuenta Google en uno de sus blogs corporativos:

"Google AI Studio es una herramienta gratuita que permite a los desarrolladores crear rápidamente prompts y luego obtener una clave de API para usar en el desarrollo de aplicaciones. Puedes iniciar sesión en Google AI Studio con tu cuenta de Google y aprovechar la cuota gratuita, que permite 60 solicitudes por minuto, 20 veces más que otras ofertas gratuitas.

Cuando estés listo, simplemente haz clic en 'Obtener código' para transferir su trabajo al IDE de su elección, o utiliza una de las plantillas de inicio rápido disponibles en Android Studio, Colab o Project IDX".

Diferencia entre Vertex AI y Google AI Studio

Google destaca la integración de AI Studio con la plataforma Vertex AI, lo que convierte al primero en una especie de campo de pruebas para aquellos interesados en explorar el ecosistema de IA generativa de Google sin necesidad de realizar un gran gasto en otros servicios.

Así, Google AI Studio como una herramienta de creación de prototipos para que desarrolladores y científicos de datos interactúen y prueben los modelos de IA de Google —incluido Gemini— lanzando aplicaciones de manera rápida y sencilla.

Por contra, Vertex AI es una plataforma de aprendizaje automático de un extremo a extremo que ofrece herramientas detalladas para el entrenamiento y la implementación de modelos. Ambos nos dan acceso a los últimos modelos de Gemini.

Precios de acceso a Gemini Pro

En este momento los desarrolladores tienen acceso gratuito a Gemini Pro y Gemini Pro Vision a través de Google AI Studio, con hasta 60 solicitudes/minuto. Los desarrolladores de Vertex AI pueden probar los mismos modelos, con los mismos límites de velocidad, sin coste alguno hasta que estén disponibles de manera general a principios del año que viene, tras lo cual se cobrará por cada 1.000 caracteres o por imagen en Google AI Studio y Vertex AI.

La estructura de precios anunciada parece diseñada para competir directamente con OpenAI y su GPT-3.5 Turbo LLM:

- El modelo Gemini Pro tendrá un precio por carácter de $0.00025 por 1.000 caracteres de entrada y $0.0005 por salida.

- Aproximadamente cuatro caracteres conforman un token, la medida más común para el procesamiento de IA generativa, por lo que el precio es de alrededor de $0.0010 por 1.000 tokens de entrada y $0.0020 por 1.000 tokens de salida…

- …exactamente el mismo precio que OpenAI cobra por GPT-3.5-turbo.

Ya no solo Python: Google Bard admite 19 lenguajes de programación como C+, JavaScript o Rust.

Google dice que los desarrolladores recurren a Bard para obtener ayuda con la programación y ahora acepta 19 lenguajes

Google Bard anunció esta semana que exporta código para replicarlo en 18 lenguajes de programación. La función Exportar a Replit de Google Bard ahora admite 19 lenguajes de programación en total, que son Python, C+, JavaScript, PHP, Bash, C, C#, C++, CSS, Dart, Go, HTML, Java, Kotlin, Ruby, Rust, SQL, Swift y TypeScript.

Otro anuncio es que ahora se usar Bard para acceder a información útil de aplicaciones y servicios de Google en japonés y coreano, además de inglés. "Con las extensiones de Bard puedes obtener información en tiempo real de YouTube, Hoteles, Vuelos y Maps, e incluso permitir que Bard acceda a información de tu cuenta de Gmail, Documentos y Drive, para que puedas encontrar, resumir y obtener respuestas fácilmente de tu contenido personal", dice el anuncio.

Qué quiere decir la integración de los lenguajes de programación en Bard

Explican desde la web oficial de la herramienta de inteligencia artificial de Google, que además de Python, la función Exportar a Replit ahora admitirá 19 lenguajes de programación, como C++ y JavaScript, Ruby, SQL y Swift.

El gigante de Mountain View afirma que "seguimos viendo que los desarrolladores recurren a Bard para obtener ayuda con la programación y nos han informado de que existe interés por utilizar las funciones específicas de programación de Bard en más lenguajes de programación".

Los usuarios de Bard pueden encontrar la opción "Exportar a Replit" en el menú "Compartir" al final de una conversación. Ahora, dicen desde Google, "después de codificar algo en Bard, puedes enviarlo a tu cuenta Replit para integrarlo con el resto de tus proyectos de codificación, como el desarrollo de complementos de WordPress".

Ya habíamos visto que Google Bard es una excelente herramienta para entornos profesionales y académicos, y que "si quieres que te ayude con cualquier materia, basta con que se lo pidas". Entre otras, también puedes hacer que te ayude con tu código y obtener así soluciones alternativas. Hasta ahora, si escribías en Python podías exportar el código a Replit y a Google Colab a través de una función integrada de Bard.

Qué es Rust y por qué se piensa que será el lenguaje con el que crearemos la 'IA General'

Rust ofrece toda una serie de ventajas frente a Python para avanzar hacia la meta de la AGI

El sector de la inteligencia artificial está a la caza de la próxima gran innovación que transforme la forma en que desarrollamos esta tecnología, y que nos acerque a la meta del desarrollo de la IA General o AGI; es decir, de aquella IA con capacidad para entender, aprender y aplicar conocimientos en una amplia variedad de tareas de manera equivalente a un ser humano.

Elon Musk, una de las figuras más influyentes en el campo de la tecnología, y él mismo co-fundador de OpenAI y, recientemente, fundador de xAI, señalaba hace unos meses en su red social que Rust podría ser el lenguaje de programación que marque la diferencia en nuestra búsqueda de la AGI.

La edad de Python termina. El tiempo de Rust ha llegado

Para entender por qué Elon Musk hace esta afirmación y por qué Rust está ganando terreno en el ámbito de la IA, es esencial analizar algunas de las razones fundamentales detrás de esta elección.

Durante los últimos 20 años, Python ha dominado el ámbito de la IA y el aprendizaje automático por su simplicidad y la gran cantidad de bibliotecas disponibles. Sin embargo, este dominio está siendo desafiado por las crecientes necesidades de eficiencia y seguridad en el procesamiento de datos.

Python, aunque es conocido por su facilidad de uso y versatilidad, es, en palabras de Chris Lattner, el creador de LLVM, Clang y Swift,

"simplemente demasiado lento, demasiado inflado y, paradójicamente, demasiado incómodo para la nueva ola de desarrolladores".

Pero, ¿qué es (y qué ofrece) Rust?

Es aquí donde Rust, un lenguaje de programación menos conocido pero extremadamente prometedor, entra en juego. Pero, ¿qué hace que Rust sea tan atractivo para la IA? Hay varias razones clave:

- Alto rendimiento: El código de Rust tiene un rendimiento excepcional sin la sobrecarga de tiempo de ejecución propio de lenguajes interpretados como Python. Así, proporciona abstracciones de alto nivel que se compilan en un código máquina, tan eficiente como el de conocidos lenguajes de bajo nivel como C/C++.

- Seguridad de memoria sin recolector de basura: A diferencia de lenguajes como Java o C#, Rust garantiza la seguridad de la memoria sin necesidad de un 'recolector de basura' (un componente que libera automáticamente la memoria que ya no está en uso,). Esto se logra mediante su sistema de 'propiedad' y 'préstamo', que elimina las pausas impredecibles en la ejecución del programa, algo crucial para sistemas en tiempo real.

- Compilador optimizado: Rust utiliza LLVM como componente central de su backend, lo que optimiza el código Rust y le permite funcionar en una amplia variedad de arquitecturas de CPU.

- Prevención de carreras de datos: Las 'carreras de datos' son un problema grave en la programación concurrente, que conduce a comportamientos impredecibles y errores en el software. Pero el sistema de tipos, propiedad y reglas de préstamo de Rust puede garantizar que los programas multi-hilo estén libres de este problema.

- Administrador de paquetes Cargo: A diferencia de C/C++ y al igual que Python, Rust cuenta con un administrador de paquetes estándar, que facilita la escritura de aplicaciones Rust con dependencias y simplifica el proceso de desarrollo.

- Acceso directo al hardware: Al igual que C/C++ y a diferencia de Python, Rust permite a los desarrolladores acceder directamente al hardware y la memoria, lo que es esencial para la programación de sistemas y aplicaciones integradas.

Rust + Wasm: combinación ganadora

Rust combinado con WebAssembly (o Wasm) —un estándar de código binario que permite ejecutar código a nivel de máquina en un navegador web— proporciona una solución más robusta para el desarrollo de infraestructuras para aplicaciones de IA, superando varios de los desafíos y limitaciones asociados con el enfoque tradicional basado en el uso conjunto de Python y Docker.

Recordemos que el código compilado con Rust y WASM tiende a ser más pequeño, lo que se traduce en tiempos de carga más rápidos y una ejecución más eficiente.

Además, el proyecto WasmEdge —un motor de ejecución para Wasm optimizado para la nube— permite a los desarrolladores utilizar Rust de alto rendimiento en todas las capas de la pila de aplicaciones IA, ofreciendo una alternativa mucho más eficiente que Python.

Rust y el futuro de la IA

En resumen, Elon Musk no está solo en su afirmación de que Rust será fundamental en la IA General. Este lenguaje combina un alto rendimiento, seguridad de memoria, un potente compilador y un sistema de tipos robusto, lo que lo convierte en una elección lógica para las aplicaciones de IA del futuro.

Así, aunque nadie pone en duda que Python seguirá siendo relevante aún por mucho tiempo en el campo de la IA, Rust se perfila como un fuerte candidato para liderar la próxima generación de inteligencias artificiales.

Proyecto IDX. La nueva herramienta de Google para desarrolladores

Hoy en día, llevar una aplicación desde cero a producción (especialmente una que funcione bien en plataformas móviles, web y de escritorio) puede ser como construir una máquina de Rube Goldberg. Tienes que navegar en un mar interminable de complejidad, uniendo con cinta adhesiva una pila de tecnología que te ayudará a iniciar, compilar, probar, implementar y monitorear tus aplicaciones.

Si bien Google ha estado trabajando para facilitar el desarrollo de aplicaciones multiplataforma durante años, desde Angular y Flutter hasta Google Cloud y Firebase , parece que pueden hacer aún más para que todo el flujo de trabajo de desarrollo de aplicaciones multiplataforma sea más rápido y sin fricciones .

Project IDX es una experiencia de desarrollo basada en navegador creada en Google Cloud e impulsada por Codey , un modelo de IA fundamental entrenado en código y construido en PaLM 2. Está diseñado para facilitar la creación, administración e implementación de aplicaciones web y multiplataforma de pila completa, con marcos y lenguajes populares. Project IDX también se basa en Code OSS , por lo que debería resultarle familiar sin importar lo que esté creando.

Ponte a trabajar rápidamente, desde cualquier lugar

En el corazón del Proyecto IDX está la convicción de que debería poderse desarrollar desde cualquier lugar, en cualquier dispositivo, con la total fidelidad del desarrollo local. Cada espacio de trabajo de Project IDX tiene todas las capacidades de una máquina virtual basada en Linux, junto con el acceso universal que conlleva estar alojado en la nube, en un centro de datos cercano.

Importe su aplicación existente o comience algo nuevo

Project IDX permite importar tus proyectos existentes desde GitHub para que puedas continuar justo donde lo dejaste. También puede crear nuevos proyectos, con plantillas prediseñadas para los frameworks más populares, incluidos Angular, Flutter, Next.js, React, Svelte, Vue y lenguajes como JavaScript, Dart y (próximamente) Python, Go y más. . También están trabajando activamente para agregar soporte de primera clase para más tipos de proyectos y frameworks.

Obtenga una vista previa de su aplicación en todas las plataformas

Crear aplicaciones exitosas hoy significa optimizar el diseño y el comportamiento de su aplicación en todas las plataformas y obtener una vista previa de sus aplicaciones tal como las verían sus usuarios. Para facilitar esto, Project IDX incluye una vista previa web incorporada y, próximamente, un emulador de Android completamente configurado y un simulador de iOS integrado, todos disponibles directamente en el navegador.

Ayuda de la IA

Dedicamos mucho tiempo a escribir código y los avances recientes en IA han creado grandes oportunidades para hacer que ese tiempo sea más productivo. Con Project IDX, se está explorando cómo las innovaciones de Google en IA, incluidos los modelos Codey y PaLM 2 que impulsan Studio Bot en Android Studio , Duet en Google Cloud y más, pueden ayudarlo no solo a escribir código más rápido, sino también a escribir código de mayor calidad. código. Actualmente, Project IDX tiene finalización de código inteligente, un chatbot de asistencia y acciones de código contextual como "agregar comentarios" y "explicar este código". Estas capacidades de IA están en sus inicios y están trabajando para hacer que IDX AI sea aún mejor para ayudarlo mientras trabaja.

Publicar en la web con Firebase Hosting

Finalmente, un problema común al poner su aplicación en producción es implementarla. Google ha hecho esto más fácil al integrar Firebase Hosting , lo que permite implementar una vista previa que se puede compartir de su aplicación web o implementarla en producción con una plataforma de alojamiento global, rápida y segura, con solo unos pocos clics. Y como Firebase Hosting admite backends dinámicos, impulsados por Cloud Functions, funciona muy bien para frameworks completos como Next.js.

Actualmente, Proyect IDX no se encuentra disponible ni se ha revelado cuál será su precio. En caso de querer probarlo, es necesario apuntarse a la lista de espera a través de la web oficial del proyecto.

GPT-4 se actualiza para dar acceso a todas sus herramientas en una misma conversación

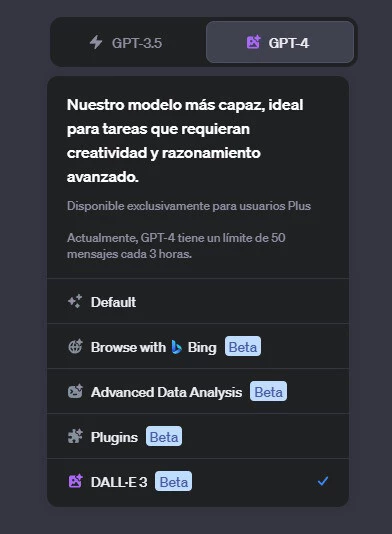

Para terminar octubre, y a las puertas de la conferencia para desarrolladores DevDay que organiza OpenAI, la compañía ha lanzado en las últimas horas una nueva actualización de su popular IA GPT-4. Y de su mano llegan un puñado de nuevas funcionalidades para los suscriptores de ChatGPT Plus (recordemos que la versión gratuita de este chatbot sólo usa GPT-3.5).

Algunos de estos suscriptores, sobre todo entre los usuarios de la versión en inglés, han empezado a visualizar este aviso al entrar en su cuenta de ChatGPT:

"Su GPT-4 ha sido actualizado

Cargue varios tipos de documentos

Trabaje con PDFs, archivos de datos o cualquier documento que desee analizar. Sólo tiene que cargarlo y empezar a hacer preguntas.

Utilice las herramientas sin cambiar

El acceso a Navegación, Análisis Avanzado de Datos y DALL-E es ahora automático. (Si lo prefiere, la selección manual sigue disponible en GPT-4)".

Las nuevas funciones

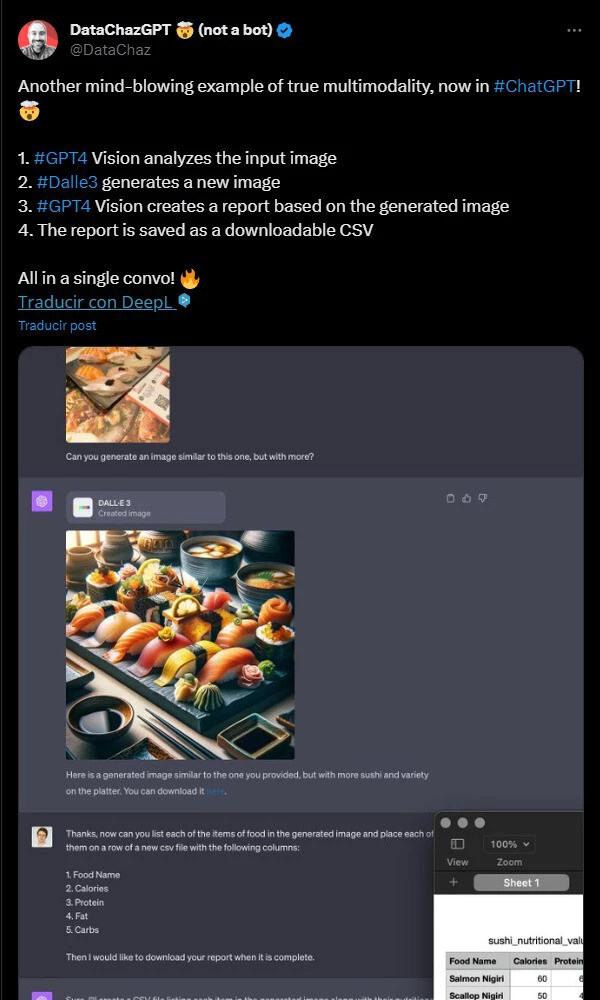

Empecemos por el final: lo que realmente ha despertado el interés es cómo GPT-4 ha evolucionado para convertirse en un "supermodelo", capaz de seleccionar automáticamente las herramientas que necesita para realizar una tarea, sin que el usuario tenga que hacerlo manualmente.

Lo cierto es que, aun si el constante feedback de los usuarios de ChatGPT no hubiera sido suficiente, el auge de los plugins de terceros que ofrecían funcionalidades similares —y que, por lo tanto, acaban de quedar obsoletas— ha resultado ser todo un toque de atención para OpenAI, que rápidamente ha tomado nota.

Junto a esto, el aspecto más destacado de esta actualización es la incorporación de la capacidad de 'leer' diferentes tipos de archivos directamente en la plataforma. Esta función, que anteriormente estaba disponible (pero poco promocionada) en el modelo de Análisis de Datos Avanzados, ahora será más accesible.

Más allá de los archivos de texto, los usuarios podrán analizar múltiples formatos de archivos de datos, o cargar imágenes y solicitar tareas creativas, como pedir que DALL·E 3 genere una imagen estilo Pixar a partir de una fotografía.

Hasta ahora, si queríamos generar una imagen tomando como referencia una preexistente, teníamos que cargar la imagen en el modo 'Default', pedir que nos generase un prompt a partir de la misma, copiarlo, pegarlo en un nuevo chat en modo 'DALL-E 3', y generar ahí la nueva imagen. Un montón de pasos que nos ahorraremos una vez esta actualización esté vigente para todos los usuarios.

Conocimiento más actualizado

Algunos usuarios han reportado discrepancias en las fechas de corte del conocimiento de ChatGPT: en algunos casos, la IA afirma tener acceso a datos actualizados a fecha de septiembre de 2023, cuando hasta ahora lo normal es que dicha fecha fuera enero de 2022.

Estas diferencias podrían estar relacionadas con la mencionada actualización de GPT-4. Esto aumentará significativamente la exactitud de las respuestas cuando impliquen hechos o conceptos recientes.

Harvard tiene cinco cursos gratis sobre inteligencia artificial a los que te puedes apuntar

Si la inteligencia artificial te llama la atención y buscas aumentar tus habilidades profesionales, hay unas cuantas maneras de empezar a formarte sin gastar ni un euro. Así, una empresa tan importante en el segmento como Google cuenta con una buena selección de cursos de IA gratis, pero no es el único: también la prestigiosa universidad Harvard ha lanzado este año cinco cursos de inteligencia artificial para principiantes (pero con formación técnica) gratis.

Nota: todos los cursos están en inglés, son online y aunque cursarlos sea gratis, en algunos casos para solicitar un certificado hay que abonar una tarifa.

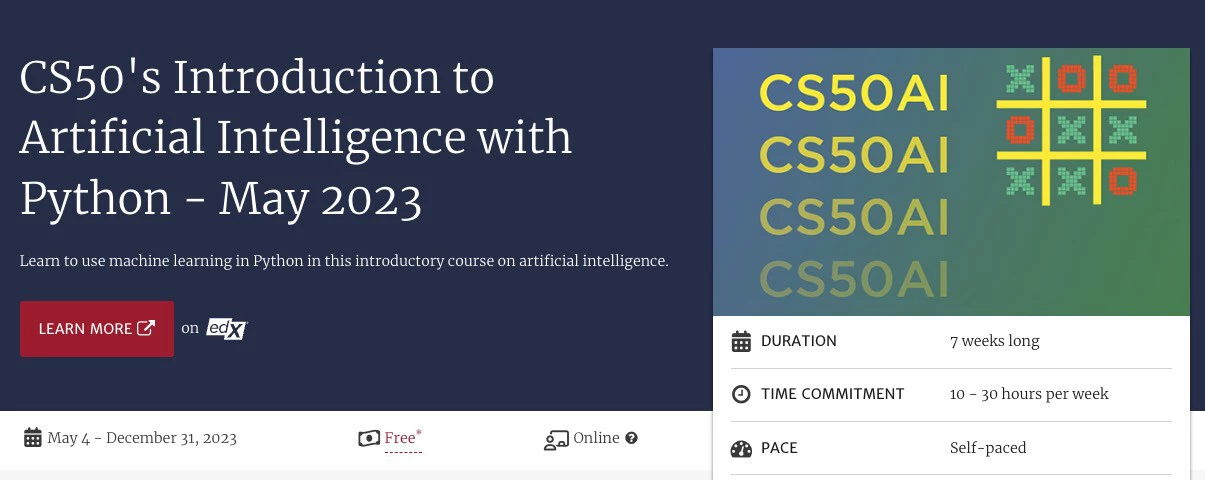

Introducción a la inteligencia artificial con Python

Si ya te manejas en Python y quieres aprovechar la IA para vitaminar tus programas, este es un curso introductorio de lo más interesante. Según el programa tiene siete semanas de duración y estima que necesitarás de 10 a 30 horas semanales para completarlo. Ojo, porque aunque fue lanzado en mayo, estará disponible hasta fin de año.

En el temario se incluyen algoritmos de búsqueda de gráficos, aprendizaje reforzado, los principios de la IA, machine learning, cómo diseñar sistemas inteligentes y cómo utilizar la IA en tus programas en Python.

CS50's Introduction to Artificial Intelligence with Python.

Ciencia de datos: machine learning

Probablemente las metodologías más famosas del análisis de datos vengan del machine learning, capaz de crear algoritmos de predicción en base a los datos. Pues bien, este curso promete enseñarte la ciencia que hay detrás y además entre sus reclamos propone crear un recomendador de películas.

Este curso de ocho semanas de duración estima que será necesario destinar entre dos y cuatro horas a la semana (aunque es una orientación, pero puedes ir a tu ritmo) para aprender los principios del machine learning, cómo realizar validaciones cruzadas, algunos algoritmos más usados de machine learning, cómo construir el sistema de recomendación, entre otras. Atención si te interesa porque el curso se cerrará pronto.

Data Science: Machine Learning[

Fundamentos de TinyML

El Tiny Machine Learning (TinyML) es una de las áreas de la IA que más crece y una de las razones es su accesibilidad, en tanto en cuanto combina el machine learning con aplicaciones, algoritmos, hardware y software de aprendizaje automático.

Este curso de cinco semanas de duración y un esfuerzo estimado de dos a cuatro horas semanales te enseñará los fundamentos de machine learning, deep learning y TinyML, cómo recopilar datos para el ML, cómo entrenar e implementar modelos, a comprender el ML integrado y a crear diseños responsables.

Análisis de datos de alta dimensión

Si eres una persona analítica y te gusta comparar datos (o trabajas en ello), este curso de ciencia de datos podría interesarte ya que se enfoca en diferentes técnicas ampliamente usadas para trabajar con altas dimensiones de datos.

Este curso de cuatro semanas de duración y una dedicación estimada de dos a cuatro horas semanales tiene como meta enseñarte cosas como la distancia matemática, reducción de dimensiones, descomposición de valores singulares y análisis de componentes, gráficos de escala multidimensional, análisis factorial y trabajar con lotes y sus efectos. El curso se cierra a finales de noviembre de este año.

High-Dimensional Data Analysis

Ciencia de datos: Capstone

Para especializarte en la ciencia de datos necesitas muchas horas de práctica a tus espaldas. Si ya te has puesto las pilas y necesitas proyectos y pruebas estimulantes para crecer, esto es lo que promete este curso eminentemente práctico y con poca orientación donde tendrás un proyecto del mundo real para el que necesitarás dar lo mejor de ti y tus conocimientos adquiridos a lo largo de esta serie.

En este proyecto final se evaluarán tus habilidades en visualización de datos, probabilidad, inferencia y modelado, manipulación de datos, regresión y machine learning. Todo ello en dos semanas con una dedicación de unas 20 horas en cada una de ellas.

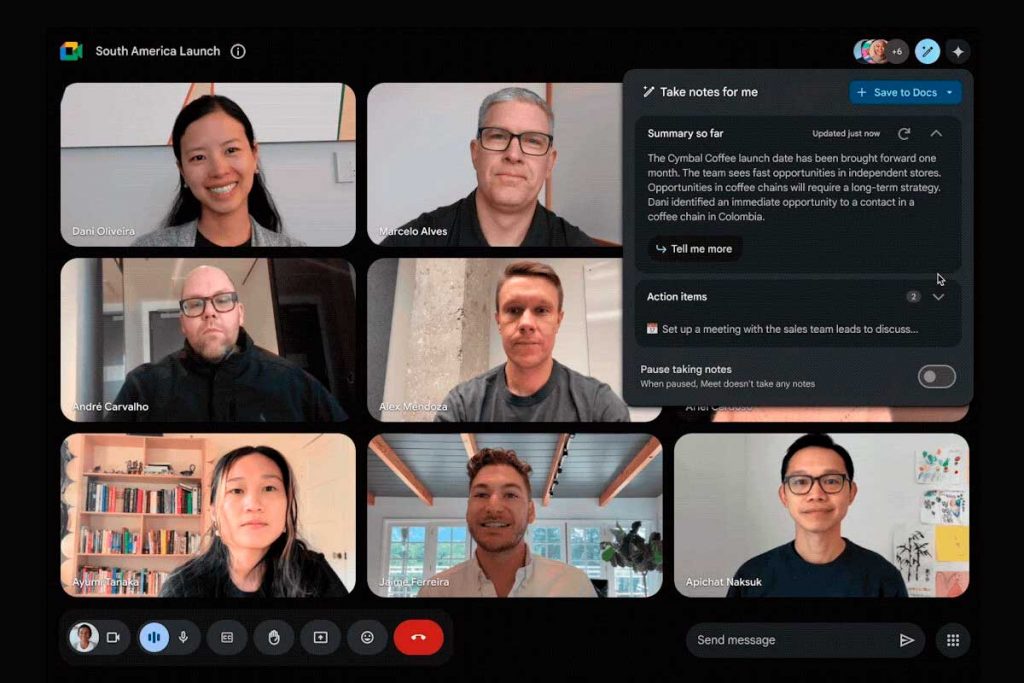

Google abre la puerta a videoconferencias en las que una IA participe en nuestro nombre

Google reveló recientemente, en el marco del evento Google Cloud Next'23, una serie de interesantes novedades relativas a su plataforma de videollamadas, Google Meet. Unas novedades que vienen de la mano de la inteligencia artificial y prometen revolucionar la manera en que interactuamos en las videoconferencias.

Y es que una de las innovaciones más destacadas es la incorporación a la aplicación de un modelo de IA generativa llamado Duet AI, que ya presentó hace unos meses y que ha incorporado a otras herramientas como Codey o Workspace.

Sin embargo, su desembarco en Meet llama notablemente la atención, porque ahora hará que esta aplicación permita al usuario no asistir a las videoconferencias… porque la IA podrá hacerlo en su lugar, y hasta tomar notas en tiempo real para cuando vuelvas.

Efectivamente, la gran novedad de esta app de videoconferencias es lograr que tu presencia ya no sea necesaria en dichas reuniones. ¿Cómo te quedas? Desgranemos esto:

Un secretario robótico

Con tan solo un clic en la función "Toma notas por mí", Meet recopilará un resumen y los principales puntos planteados mientras la reunión está en curso. Incluso si llegas tarde a una reunión, será capaz de proporcionarte un resumen a mitad de la conversación para que puedas ponerte al día en un momento.

Además, durante la llamada, podrás comunicarte en privado con un chatbot de Google para revisar detalles que puedas haber perdido. Una vez finalizada la reunión, podrás guardar el resumen en Google Docs, incluyendo —incluso— clips de vídeo de los momentos importantes.

Aunque esta función es prometedora, lograr la precisión necesaria será todo un reto, puesto que necesita refleja con exactitud lo sucedido en la reunión para convertirse realmente en una función efectiva.

Un 'doble' digital (o casi)

La otra gran característica destacable de Duet AI en Meet es la posibilidad de que la IA "asista" a una reunión en tu nombre. Al recibir una invitación a una reunión, podrás activar la opción "asistir por mí", lo que generará automáticamente anotaciones sobre los temas que podrías querer discutir. Estas notas serán visibles para los asistentes, lo que facilita el flujo de la conversación.

Sin embargo, si el principal reto de la anterior función era de tipo técnico, aquí nos encontramos ante un dilema ético, pues genera un incentivo malicioso para que la gente abuse de esta opción para saltarse reuniones importantes…

…aunque esté pensada para situaciones en las que un usuario está ocupado o no puede asistir legítimamente a una reunión. Google no ha aclarado qué pasaría si en una reunión todo el mundo optase por acogerse a esta opción.

Privacidad

Google ha querido aclarar hoy que los datos que los clientes empresariales introducen en Workspace tampoco se usan para entrenar modelos, y quedan relegados al entorno privado de la empresa.

Meta planta cara a GitHub Copilot

Desde hace algún tiempo, existen quejas sobre el progresivo 'atontamiento' de ChatGPT, especialmente acusado en su faceta de 'asistente' de codificación de software, y ahora sabemos que una gran compañía de Silicon Valley está a punto de lanzar al mercado su propio generador de código basado en IA de forma inminente.

Plantaría, así, cara tanto a OpenAI como a Google, que hace poco anunció su intención de lanzar su propio 'Visual Studio Code en la nube impulsado por inteligencia artificial' con Project IDX.

Meta LLaMa 2 veces a la puerta de los desarrolladores

Y no es otra que Meta la compañía, que, según publica The Information, está a punto de presentar un software diseñado para ayudar a los desarrolladores a generar automáticamente código de programación. Este innovador producto. de código (supuestamente) abierto y bautizado como Code Llama, va a ser lanzado la próxima semana, según "fuentes cercanas al desarrollo".

Este nuevo modelo de programación es un competidor directo del modelo Codex de OpenAI (la tecnología que está detrás de GitHub Copilot) y, como su nombre ya indicaba, se basa en el recientemente lanzado LLaMa 2 de Meta, un modelo de lenguaje que facilita su adaptación y personalización para empresas y tareas específicas.

Y además, CodeCompose para consumo interno

No contento con esto, Meta también ha estado trabajando en otra herramienta muy similar, CodeCompose, que ya ha implementado internamente. CodeCompose no se basa en LLaMa 2 sino en InCoder, y se ha escalado para dar servicio a decenas de miles de desarrolladores en Meta, abarcando varios lenguajes de programación.

En sólo 15 días, el impacto de CodeCompose en la experiencia interna de generación de código para Meta ha sido significativo: ya ha realizado 4,5 millones de sugerencias, con una tasa de aceptación media del 22%, en varios idiomas. Además, según afirma la compañía, CodeCompose ha tenido otros efectos positivos, como alentar a los desarrolladores a generar más documentación en el código y ayudarlos a descubrir nuevas APIs.

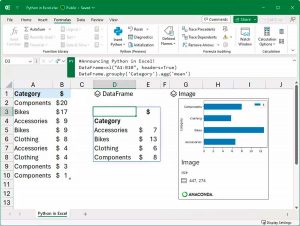

Microsoft lleva Python a Excel

No hay duda de que Microsoft Excel es una herramienta extremadamente potente cuando le sabemos sacar todo el provecho. Sin embargo, la compañía acaba de potenciar aún más su herramienta de ofimática con la integración oficial de Python.

La idea es que la llegada de Python a Excel pueda darles a los usuarios la posibilidad de incrementar aún más las opciones en cuanto a análisis de datos, herramientas de visualización, y mucho más. Microsoft ha anunciado este gran cambio a través de una entrada en su blog oficial. Bajo estas líneas te contamos los detalles.

Python se integra en Excel y ya lo puedes probar

Python se ha consagrado como uno de los lenguajes de programación más populares y versátiles de la actualidad. Ahora, los usuarios podrán utilizar sus bases para crear y experimentar en Excel como nunca antes.

Los usuarios ya pueden disfrutar de una preview pública de Python en Excel desde ya, permitiendo manipular y analizar datos a través de las funciones integradas de este lenguaje de programación.

"Puedes manipular y explorar datos en Excel utilizando gráficos y bibliotecas de Python y, a continuación, utilizar las fórmulas, gráficos y tablas dinámicas de Excel para afinar aún más tus conocimientos,” explicaba Stefan Kinnestrand, manager general de trabajo moderno en Microsoft. “Ahora puedes realizar análisis avanzados de datos en el entorno familiar de Excel accediendo a Python directamente desde la cinta de opciones de Excel," continuaba.

Lo mejor de todo es que no tendrás que instalar ningún tipo de software adicional ni plugin para acceder a esta funcionalidad, ya que Python se incorporará a Excel por medio de los conectores Power Query integrados de Excel.

Para acceder a las funciones de Python en Excel, lo único que tienes que hacer es escribir ‘PY’ en cualquier celda, siendo muy similar a cuando ponemos ‘=’ para acceder a las funciones en Excel. Por medio de Anaconda, el repositorio de Python para empresas, librerías tan reconocidas de Python como pandas, statsmodels, Matplotlib y otras tantas, estarán disponibles en Excel.

Los cálculos de Python por su parte, se ejecutarán en Microsoft Cloud, mientras que los resultados se plasmarán en las hojas de cálculo una vez procesados. Los usuarios de Excel podrán crear fórmulas, tablas, gráficos y más; todo basado en Python.

Los usuarios pueden acceder a esta nueva integración por medio del canal para insiders de Microsoft 365 o el canal beta. Primero será una prueba limitada para usuarios de Windows, mientras que más adelante se lanzará para el resto de plataformas. Durante la preview, Python en Excel se incluirá en la suscripción de Microsoft 365. Esto significa que tras la prueba, algunas funcionalidades estarán restringidas sin una licencia de pago.